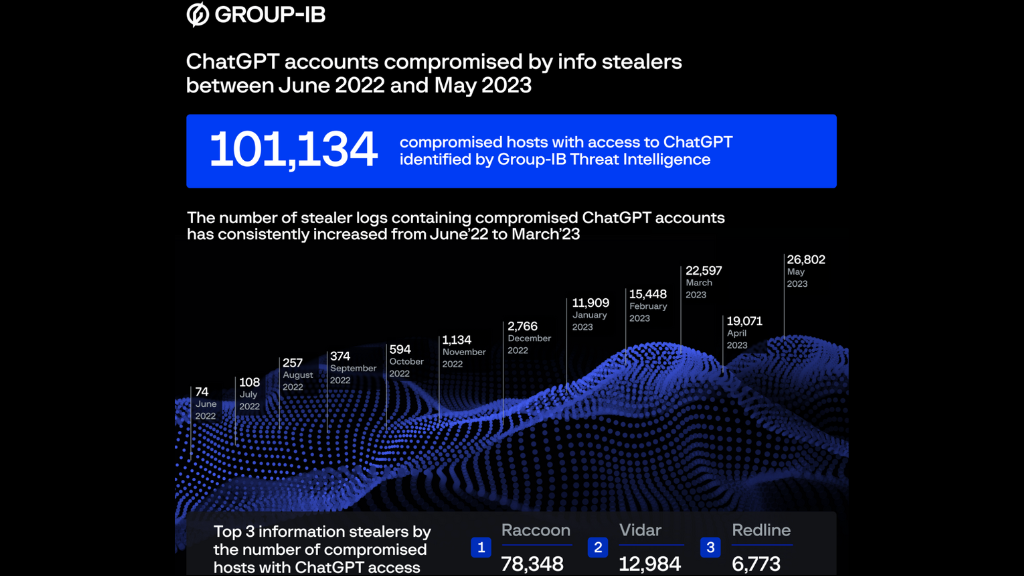

Statistiken aus dem Dark-Web-Markt zeigen, dass im letzten Jahr über 101.000 ChatGPT-Kontodaten durch Spyware zum Datendiebstahl illegal erlangt wurden.

Group-IB, ein Cyber-Intelligence-Unternehmen, hat die Entdeckung von über hunderttausend Datensätzen mit gestohlenen Informationen von ChatGPT-Konten auf verschiedenen Untergrund-Websites gemeldet. Die meisten Vorfälle ereigneten sich im Mai 2023, als böswillige Akteure 26.800 neue ChatGPT-Anmeldedaten veröffentlichten.

Der asiatisch-pazifische Raum war von Juni 2022 bis Mai 2023 mit rund 41.000 gehackten Konten am häufigsten betroffen. Nordamerika lag mit 4.700 gehackten Konten an sechster Stelle, während Europa mit rund 17.000 betroffenen Nutzern an zweiter Stelle lag.

Informationsdiebe beziehen sich auf Malware, die explizit auf Kontodaten abzielt, die in Anwendungen wie E-Mail-Clients, Webbrowsern, Instant Messengern, Spieldiensten und Kryptowährungs-Wallets gespeichert sind.

Diese Art von Malware ist dafür berüchtigt, in Webbrowsern gespeicherte Anmeldeinformationen zu extrahieren, indem sie auf die SQLite-Datenbank des Programms zugreift und die Funktion CryptProtectData ausnutzt, um die gespeicherten Geheimnisse zu entschlüsseln.

Die kompromittierten Informationen, einschließlich der Kennwörter, werden dann in Aufzeichnungen gesammelt und zur Wiederherstellung an die Systeme der Hacker zurückgegeben.

Die Verwundbarkeit von ChatGPT-Konten, zusätzlich zu anderen Daten, auf die es normalerweise abgesehen ist, wie E-Mail-Adressen, Kreditkartennummern, Bitcoin-Wallet-Informationen und andere, unterstreicht die zunehmende Bedeutung von KI-gestützten Anwendungen für Verbraucher und Unternehmen.

Der unbefugte Zugriff auf ein Profil könnte geheime Daten, Insider-Geschäftstaktiken, private Chats, Programmcodes usw. enthüllen, da ChatGPT den Mitgliedern erlaubt, Chats zu speichern.

Dmitry Shestakov von Group-IB kommentiert: “Viele Unternehmen binden ChatGPT in ihre betrieblichen Abläufe ein. Mitarbeiter kommunizieren informell oder nutzen den Bot, um vertraulichen Code zu verbessern. Da die Standardkonfiguration von ChatGPT alle Unterhaltungen aufzeichnet, könnte die Erlangung von Zugangsdaten unbeabsichtigt eine Fülle von sensiblen Informationen für Bedrohungsakteure liefern.”

Lesen Sie auch: “Flicken von Sicherheitslücken: ASUS Firmware-Updates beheben mehrere Sicherheitslücken in Router-Modellen”

Bedenken dieser Art haben Tech-Giganten wie Samsung dazu veranlasst, ChatGPT auf Arbeitscomputern zu verbieten und Mitarbeitern, die sich nicht an diese Richtlinie halten, sogar mit Kündigung zu drohen.

Die Daten von Group-IB zeigen, dass die Zahl der gestohlenen ChatGPT-Protokolle im Laufe der Zeit stetig zunimmt. Die meisten, nämlich fast 80 %, stammen vom Raccoon Stealer, gefolgt von Vidar (13 %) und Redline (7 %).

Wenn Sie sensible Daten in ChatGPT eingeben, ist es ratsam, die Funktion zum Speichern von Konversationen im Einstellungsmenü der Plattform zu deaktivieren oder diese Konversationen nach Beendigung der Nutzung des Tools manuell zu löschen.

Es ist jedoch zu beachten, dass viele Datendiebe Screenshots von infizierten Systemen erstellen oder Keylogging-Techniken einsetzen. Selbst wenn Sie also keine Unterhaltungen in Ihrem ChatGPT-Konto speichern, kann eine Malware-Infektion zu einer Datenverletzung führen.

Leider gab es bei ChatGPT zuvor einen Hacking-Vorfall, bei dem Benutzer die privaten Informationen und Gesprächsanfragen anderer Benutzer einsehen konnten.

Daher sollten Personen, die mit sensiblen Informationen arbeiten, bei der Eingabe solcher Daten nicht auf Cloud-Dienste vertrauen, sondern stattdessen auf sichere, lokal entwickelte und selbst gehostete Tools zurückgreifen.

0 Comments